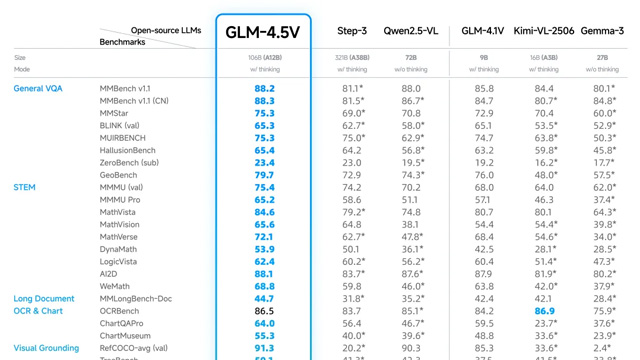

Zhipu AI(智譜)は、総パラメータ106B・アクティブ12Bのオープンソース多機能推論モデル「GLM-4.5V」を発表した。GLM-4.1V-Thinkingの技術を継承し、41の公開ベンチマークで同規模オープンソースモデルのSOTA性能を達成。画像推論、動画理解、GUIタスク、複雑文書解析、Groundingなど幅広いタスクをカバーする。

ユーザーは「思考モード」切替で応答速度と推論深度を調整でき、APIは入力2元(約42円)/M tokens、出力6元(約126円)/M tokensと低コストで提供され、毎秒60〜80 tokensの高速応答を実現。モデルは物体の座標指定による高精度な視覚定位、ウェブ画面のコード復元、画像からの位置推定ゲームで人間上位1%の成績達成、長文書・複雑図表の正確な解析、GUI上での商品価格解析など、多様な場面で人間を凌駕する性能を示した。

モデル構造は視覚エンコーダ、MLPアダプタ、言語デコーダで構成され、64Kトークンの多機能長文脈入力をサポート。3D畳み込みと3D-RoPEにより動画処理と空間推論を強化。学習は大規模多機能コーパスによる事前学習、明示的思考連鎖を含むSFT、多分野報酬システムを用いたRLHF・RLVRで構成される。Zhipu AIはこのモデルを通じ、AGIに向けた多機能推論の進化を加速させるとしている。