Kunlun Techは8月11日、音声駆動型バーチャルヒューマン生成モデル「SkyReels-A3」を正式発表した。本モデルはDiT(Diffusion Transformer)動画拡散モデルに加え、挿入フレームによる映像延長、強化学習による動作最適化、そしてControlNet構造を活用した精密なカメラワーク制御を組み合わせることで、任意の長さの全モーダル映像生成を可能にする。

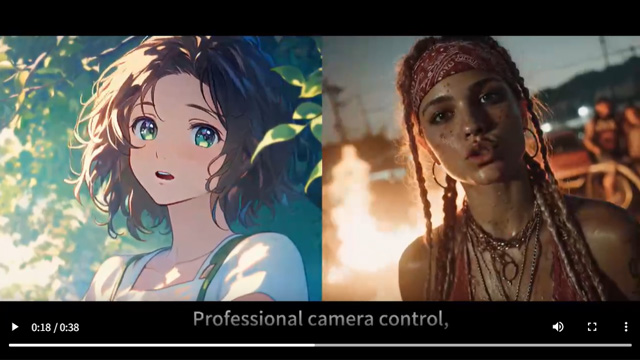

ユーザーは写真と音声を入力するだけで、人物が自然に話す・歌う映像を生成でき、テキストプロンプトを加えれば演技内容や場面変化も指示できる。既存動画の音声差し替えにも対応し、口の動きや表情、しぐさを新音声に同期させながら映像の連続性を維持する。

SkyReels-A3は最大60秒の単一カット動画、マルチカットでは無制限長の映像生成に対応。さらに、固定・推し・引き・パン・クレーンなど8種のカメラワークを0〜100%の範囲で強度調整でき、音楽MVや映画的演出など芸術性の高いシーンにも適用できる。モデル内部では3D-VAEにより時空間圧縮された潜在空間で生成を行い、計算効率と品質を両立している。

OmniAvatarやOmniHumanなど既存の開発済みモデルと比較した評価では、口の動き同期やしぐさの自然さ、映像品質で優れた結果を示した。推論ステップ数も従来の40から4に削減しつつ品質を維持している。

広告・ライブ配信・映画制作・ゲーム開発・教育など幅広い分野で、専門設備不要・低コスト・高精度のコンテンツ制作を実現するSkyReels-A3は、「声がそのまま映像になる」新たな制作スタイルを提示している。静止画を動かす、動画の台詞を差し替える、長時間のバーチャルヒューマン配信を行うといった用途で、これまでにない効率と表現力を提供する。