テンセントは、大規模動画生成モデル「HunyuanVideo」を基盤にしたマルチモーダル動画生成ツール「HunyuanCustom(混元カスタム)」を発表し、GitHubでオープンソースとして公開した。HunyuanCustomは、画像・テキスト・音声・映像の複数モーダルを入力に用い、高い制御性と表現力を備えた自然な動画を生成できるのが特徴。

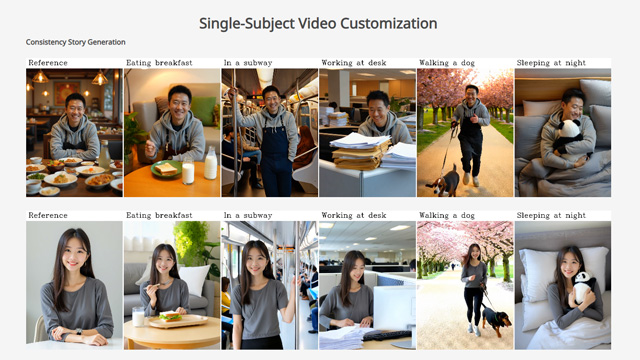

単一人物や複数人物・物体を入力として、動作・背景・表情を自由に変更できるだけでなく、音声に連動してキャラクターが歌ったり話したりする映像を作成できる。従来の画像ベース動画生成モデルでは困難だった、服装や動作、場面の切り替えにも対応可能となっている。

また、音声駆動や映像挿入などの高度な表現にも対応し、教育コンテンツやバーチャル接客、ストーリー動画の制作にも有用。テンセントは「画像が誰かを決め、テキストが何をするかを決める」という方針で、人物の外観や動作を一貫して制御できるアーキテクチャを確立した。

技術的には、強力な多モーダル理解能力と主体一貫性モデリングによって、映像中での「変顔」や「物体のズレ」が生じない安定した表現が可能。高精細な人物描写、滑らかな動き、リアルな光影表現により、プロユースにも対応する品質を実現している。

現在は単主体生成機能が公式サイトで体験可能であり、他の機能も5月中に順次公開予定。公式サイトや技術論文では、詳細な構成・原理・応用事例も紹介されている。