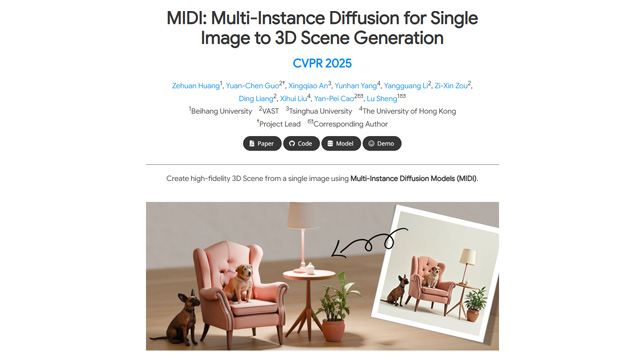

CVPR 2025に採択された「MIDI」は、単一の2D画像から複数の3Dオブジェクトを同時に生成し、構造的整合性をもった3Dシーンを合成する新たなマルチインスタンス拡散モデルである。従来の手法では、リトリーバルや逐次的な個別再構成が必要だったのに対し、MIDIは事前学習済みの画像→3Dオブジェクト生成モデルを拡張し、複数インスタンスの同時生成とそれらの空間関係を一括して扱うことができる。特に特徴的なのは、マルチインスタンス注意メカニズムの導入により、オブジェクト間の相互作用と空間的な一貫性を効果的に捉えた生成を実現している点だ。

MIDIは、入力画像をセグメント化し、それぞれの領域から3Dオブジェクトを並列に生成し、最終的に統合された高精度の3Dシーンを出力する。処理時間はおよそ40秒と高速であり、複雑な後処理や個別の最適化プロセスは不要だ。さらに、合成データ(3D-FrontやBlendSwapなど)による学習のみでありながら、実写画像やスタイル化画像に対しても高い汎化性能を示しており、生成された3Dシーンの精度とリアリズムの両立を可能にしている。

2025年3月には、MIDI-3Dのモデルの重み、Gradioデモ、推論スクリプトが正式に公開された。GitHub上ではコードと推論スクリプトが入手可能で、Hugging FaceのGradioデモを通じてブラウザ上でMIDIの3D生成プロセスを体験できる。また、公式ページにはプロジェクト全体の概要や成果がまとめられており、開発者や研究者が迅速に技術内容を把握し応用できる構成となっている。インストール手順も明快で、PyTorchベースの環境があれば数ステップで導入可能だ。

MIDIは、画像から3Dシーンを再構成する分野において、性能と効率、そして汎化能力を兼ね備えた最先端の技術であり、今後のAIGC(AI生成コンテンツ)やメタバース、デジタルツイン分野において実用化が期待されるアプローチである。

CVPRとは?:

CVPR(Conference on Computer Vision and Pattern Recognition)は、コンピュータビジョン分野における世界最高峰の国際会議で、AI、画像認識、3Dモデリングなど最先端の研究が発表される場。IEEEが主催し、毎年採択率20〜25%前後という厳しい審査を通過した論文のみが発表される。採択は技術的信頼性と国際的評価を得た証とされる。