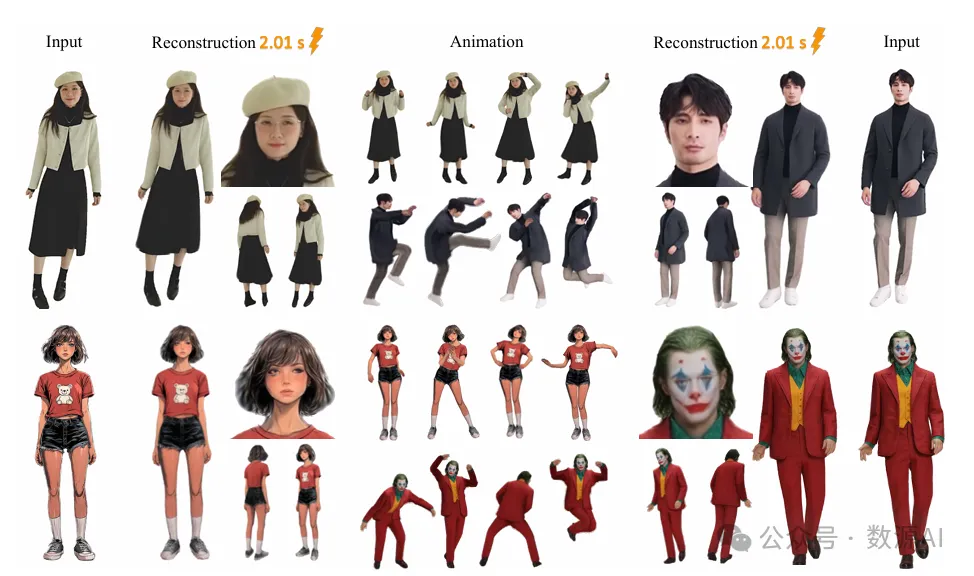

アリババのTongyi Lab(通義実験室)が新たに発表した3D人体再構成モデル「LHM(Large Animatable Human Reconstruction Model)」は、単一のRGB画像から高精度かつアニメーション可能な3Dアバターをわずか数秒で生成する革新的技術として注目を集めている。LHMは3Dガウススプラッティング(3DGS)を用いた高効率な表現方式を採用し、リアルタイムでのレンダリングやポーズ制御に対応。現実世界の写真1枚から瞬時にバーチャル人体を立ち上げる。

本モデルの特徴は、身体と頭部の情報を統合するために独自のマルチモーダルTransformer「MBHT(Multimodal Body-Head Transformer)」を導入し、3D幾何特徴と2D画像特徴の精密な統合を実現。特に頭部の微細な表情やディテール再現を目的に、層構造を持つ「HFPE(Head Feature Pyramid Encoding)」を新たに設計。DINOv2から多階層の特徴を抽出し、高周波成分と幾何的先験知識の両方を保持する。

学習データには約30万件の自然動画と複数の高品質な合成スキャンデータを使用し、SMPL-Xによるポーズ推定とSAMURAIによる前景抽出を組み合わせた堅牢な前処理パイプラインが構築された。トレーニングはNVIDIA A100 GPUクラスタ上で大規模に実施され、最大10億パラメータモデルまでスケール可能。小型モデルから大規模モデルまで、パラメータ数の増加に応じて性能がスムーズに向上することが確認された。

論文によると、LHMはDreamGaussian、AniGS、PSHumanなどの既存手法と比較して、再構成精度(PSNR、SSIM)、テクスチャの忠実度(LPIPS)、顔の一貫性(FC)すべてで上回る結果を記録。さらに、LHMは推論速度でも優位で、競合手法が2分以上かかる処理を数秒で完了できる。アニメーションの一貫性や自然さの面でも、実写映像と比較して極めて高い整合性を示し、合成感の少ない出力が得られる。

本モデルは2025年3月13日にオープンソースとしてGitHub上で初公開され、LHM-0.5BおよびLHM-1Bの学習済みモデル、リアルタイムレンダリングパイプライン、推論コード、Hugging Face上のオンラインデモが同時に提供された。さらに、2025年3月15日には推論時間を約30%短縮する最適化アップデートも実施されている。

本研究は、AR/VR分野におけるリアルタイムアバター生成、デジタルヒューマン制作、仮想接客やゲーム開発など多様なユースケースへの応用が期待される。コードはGitHub上で一般公開されており、研究や実務への迅速な導入が可能となっている。