中国のAI開発チーム「問小白(Wenxiaobai)」開発チームは、革新的な強化学習手法と高効率なデータ生成技術を活用し、7Bパラメータの軽量モデル「MetaStone-L1-7B」を開発、オープンソースとして公開した。同モデルは、数学およびプログラミング分野の推論タスクにおいて、同クラスの軽量モデルの中でSOTA(State-of-the-Art)性能を達成し、Claude-3.5-SonnetやGPT-4oをも上回る実力を示した。

MetaStone-L1-7Bの開発は、チームが提案する新しい強化学習フレームワーク「Iterative Reinforcement Learning(IRL)」に基づいている。これは、訓練→推論→データ進化の三段階を繰り返す学習サイクルを軸とし、複数モデルの並列処理によって強力かつ効率的な学習を可能にするものだ。これにより、わずか43,000件の学習データで従来モデルを凌ぐ性能を獲得した。

データ生成においては、「Multi-agent Synthetic Data Algorithm」を採用。この手法は複数のエージェントが協調して推論データを自動生成するもので、2024年発表のグラフベース合成技術をさらに進化させたもの。各エージェントは、問題生成・解答・検証の役割を担い、高品質な推論データを継続的に供給する。

さらに、Wenxiaobai開発チームはデータ効率にも強いこだわりを見せている。訓練過程では「漸進式コンテキスト拡張」や「混合報酬関数」などの新アルゴリズムを導入し、データ効率を33%向上。少量データでより高精度な学習が可能となり、軽量モデルでもハイレベルな性能を実現した。

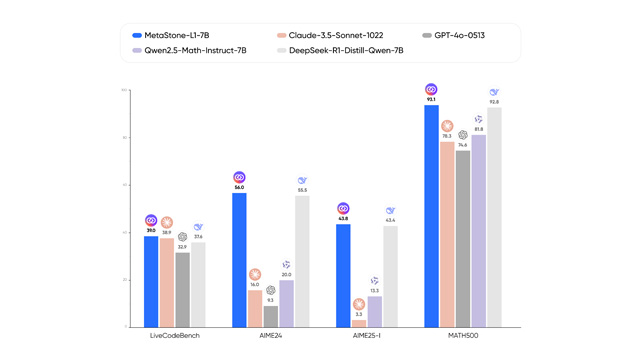

このMetaStone-L1-7Bは7Bという比較的小型の構成ながら、推論能力ではLiveCodeBenchなどの業界標準ベンチマークでClaude-3.5やDeepSeek R1の蒸留モデルを上回り、数学においては全米数学競技会(AIME 24/25)でも高得点を記録した。コード生成と数学推論の「二刀流性能」を強調し、「小さくても強い」モデルとして注目を集めている。

加えて、モデルの量子化と最適化により、スマートフォンなどのローカルデバイスでも動作可能であり、100万トークンあたりの推論コストはわずか0.2元という圧倒的な低コストを実現。これにより、企業利用のみならず個人ユースにも適したAI推論基盤としての展望が広がる。

MetaStone-L1-7Bは、Apache 2.0ライセンスでHugging FaceおよびModelScope上にて無料で公開されており、論文もarXivに掲載済み。また、公式ウェブアプリ上で誰でもモデルを試用可能となっており、中国発の先進的な軽量AI技術の実用化が本格化している。今後、同手法を用いたより大規模なモデルの公開も予定されており、「オープンかつ高性能な推論モデル」を軸とする問小白(Wenxiaobai)開発チームの戦略は、グローバルなAIエコシステムにも新たな影響を与える可能性がある。