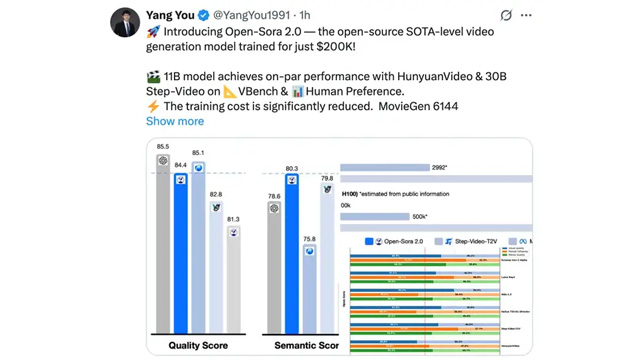

オープンソースAIプロジェクト「Open-Sora 2.0」が、2025年3月12日に正式リリースされた。パラメータ数は11Bと大規模ながら、わずか224枚のGPUと約20万ドルという低コストで訓練され、商用のクローズドモデルに匹敵する動画生成性能を実現した。これまで数百万ドルの訓練費用が必要とされてきた同等レベルのモデルと比べて、圧倒的なコストパフォーマンスを誇る。

生成される動画は720P・24FPSに対応し、人物動作や物理現象を高い精度で再現する。テキストとの整合性、動きの滑らかさ、映像のリアリティといった観点でも高評価を獲得。動画生成のベンチマークであるVBenchでは、前バージョン1.2との性能差を大きく縮め、OpenAIのSoraと比較してわずか0.69%差に迫る。HunyuanVideoやStep-Video(30B)とも同等レベルのスコアを記録している。

アーキテクチャには3D全注意メカニズムやMMDiT構造が採用され、低解像度動画での学習によって効率よく運動情報を獲得。さらに、ColossalAIを活用した分散学習や、Zero Redundancy Data Parallel(ZeroDP)、グラデーションチェックポイント、学習自動復旧機構などの技術によって、リソースの無駄を最小限に抑えている。

推論の高速化においては、高圧縮比(4×32×32)のVAE(変分オートエンコーダー)を導入。従来では1枚のGPUで5秒の768px動画を生成するのに30分を要したが、Open-Sora 2.0では3分以内に短縮し、10倍以上の高速化を実現している。残差接続や蒸留学習を用いることで、高圧縮でありながらも高い復元精度を両立させた。

また、段階的な訓練アプローチ(T2I → T2V → 高解像度T2V)と「バケットトレーニング」により、多様な解像度と長さの動画に柔軟に対応。1000万件規模の動画データをもとに、効率的かつ高品質な学習を行っている。

すべての推論コード・学習コード・モデル重み・設定ファイルがGitHub上で公開されており、誰でもローカル環境での再現・応用が可能。高性能・低コスト・高再現性という三拍子が揃ったこのプロジェクトは、動画生成AI分野における新たな基準となり得る存在だ。

【関連リンク】

GitHubリポジトリ:https://github.com/hpcaitech/Open-Sora

技術レポート:https://github.com/hpcaitech/Open-Sora-Demo/blob/main/paper/Open_Sora_2_tech_report.pdf